Возможности Google в области искусственного интеллекта стремительно развиваются: обзоры с использованием ИИ стали появляться по все большему числу поисковых запросов. Несмотря на постоянные изменения формата органической выдачи, основы SEO остаются актуальными.

Зачем смотреть на сайт «глазами» робота Google?

Если вы хотите, чтобы ваш сайт индексировался, высоко ранжировался в результатах поиска, а также фигурировал в сгенерированных ответах искусственного интеллекта, важно убедиться, что Googlebot (как и другие поисковые системы) имеют доступ не только к страницам сайта, но и к их контенту.

Если робот Googlebot не может получить доступ к контенту страницы, он не может быть процитирован, а значит страница не займет ожидаемые позиции и не попадет в поле зрения ИИ.

Такая проблема достаточно распространенная и может встречаться практически на любом типе сайтов. Например, у интернет-магазина могут быть скрыты превью карточек товаров.

В таких случаях поисковым роботам сложнее обнаружить ссылки на детальные страницы карточек товаров, чтобы просканировать их, проиндексировать или цитировать, особенно если на них нет ссылок с других страниц сайта или они не включены в файл sitemap.xml (а должны быть!).

Если вы подозреваете, что поисковик не может получить доступ к какой-либо части контента вашего документа, предлагаем пять способов, которые помогут вам увидеть ваш сайт так, как его видит Googlebot. При необходимости можете использовать несколько из этих методов одновременно, чтобы убедиться, что получаются идентичные результаты везде.

Давайте приступим!

1. Google Search Console

Google Search Console — это бесплатный инструмент, в котором должны быть добавлены все сайты у SEO-специалиста. Помимо просмотра данных об эффективности органического поиска, вы также можете проверять отдельные URL-адреса на наличие проблем с индексацией, запросив информацию из индекса Google или запустив тестирование в реальном времени.

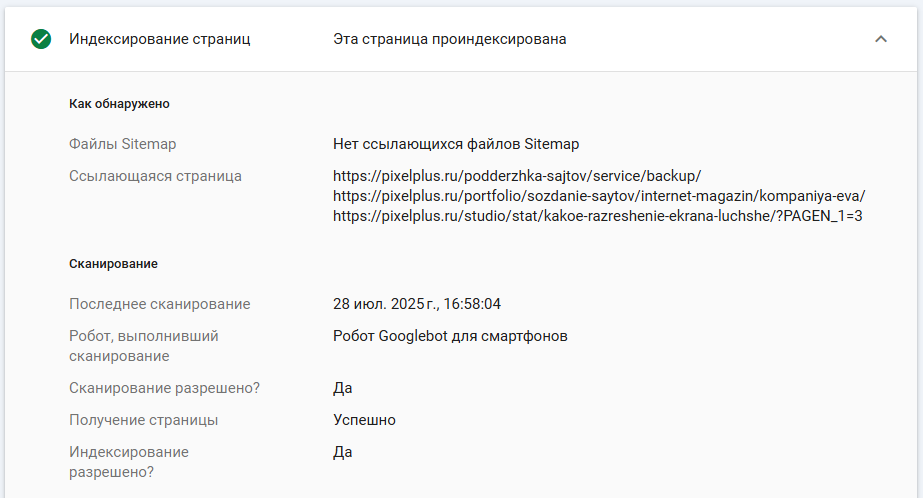

Запрос информации из индекса Google позволит вам узнать, был ли URL-адрес проиндексирован или нет во время сканирования. Это полезно для определения, не индексируется ли URL-адрес из-за тега noindex, канонического адреса или документ не может быть просканирован из-за блокировки в файле robots.txt. Вы также можете узнать, откуда робот Googlebot обнаружил ваш URL-адрес (из карты сайта, с внешнего сайта и т. д.).

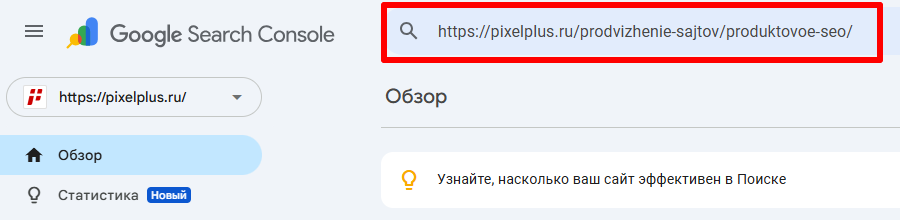

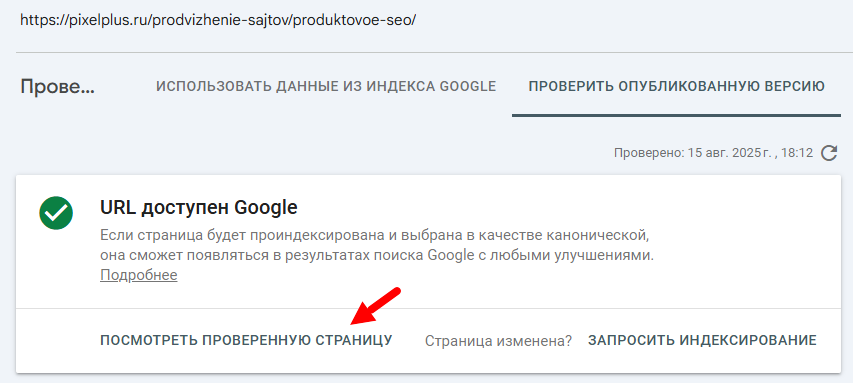

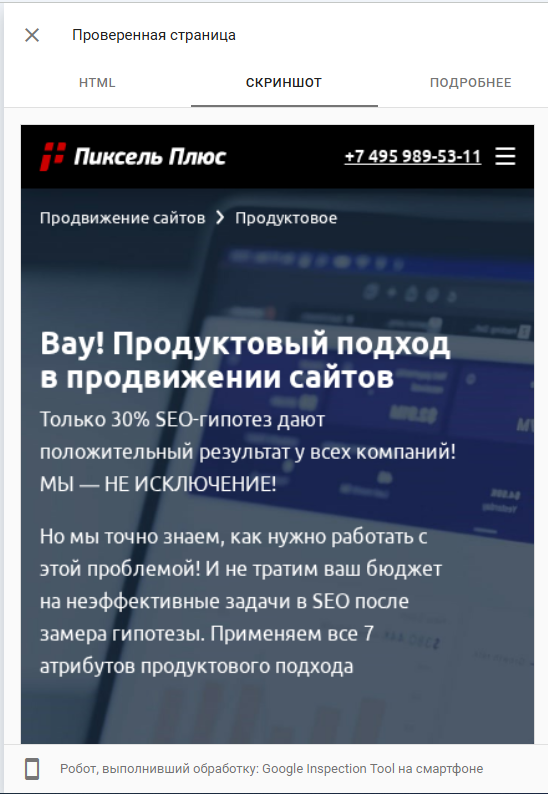

Но если вы хотите увидеть, как Google видит вашу страницу сейчас, вам необходимо запустить тестирование в реальном времени. Для этого:

- Проверьте нужный URL-адрес, используя строку поиска в верхней части платформы или отчёт «Эффективность» или «Индексирование».

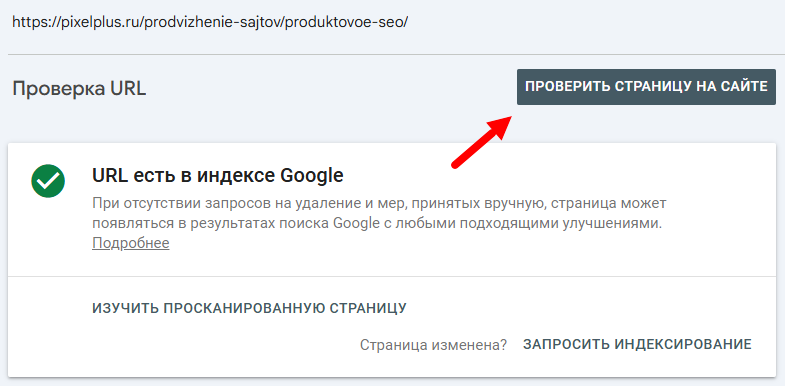

- После проверки URL-адреса выберите «Проверить страницу на сайте» в правом верхнем углу:

- После завершения теста нажмите «Просмотреть проверенную страницу», чтобы открыть окно с HTML-кодом страницы, скриншотом и дополнительной информацией о странице, например, типом контента и HTTP-ответом.

- Данные о странице представлены из первоисточника, а не от сторонних сервисов. Поэтому, если вы хотите узнать, что видит Googlebot, лучше начните с этого метода.

- Использование панели Google Search Console — бесплатно.

- Одновременно можно тестировать только один URL-адрес.

- Google Search Console ограничивает количество живых тестов, которые вы можете запустить за день.

- Программа позволяет просматривать страницы в масштабе, поэтому вы можете анализировать несколько URL-адресов одновременно.

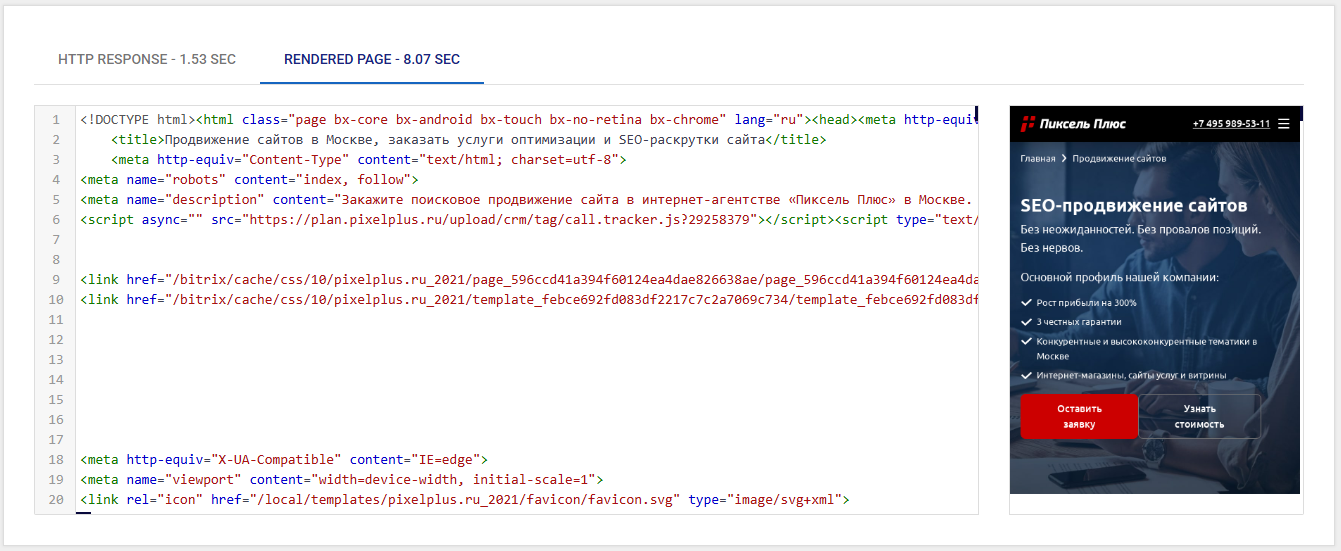

- Можно изменить User-Agent для любого поискового робота.

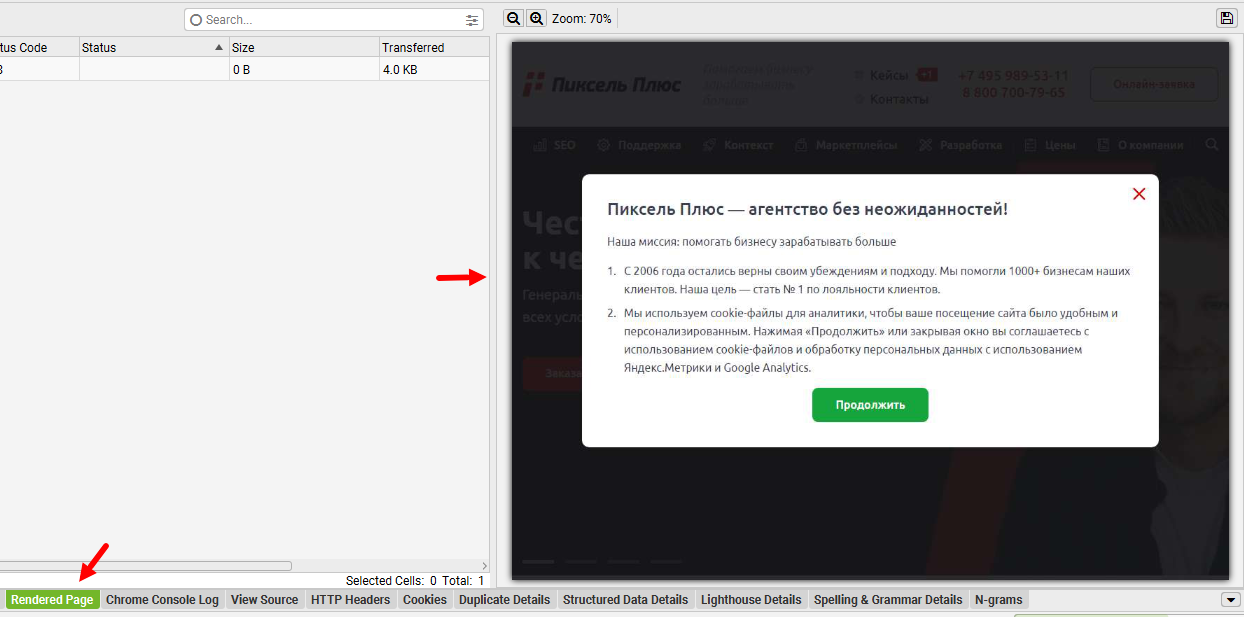

- Вкладка «Rendered Page» позволит увидеть, как страница отображается роботом Googlebot (или другим поисковым роботом), если в настройках включена функция рендеринга JavaScript и выбран нужный вам User-Agent.

- Бесплатная версия программы позволяет просканировать не более 500 URL, чтобы сканировать больше — необходима покупка лицензии.

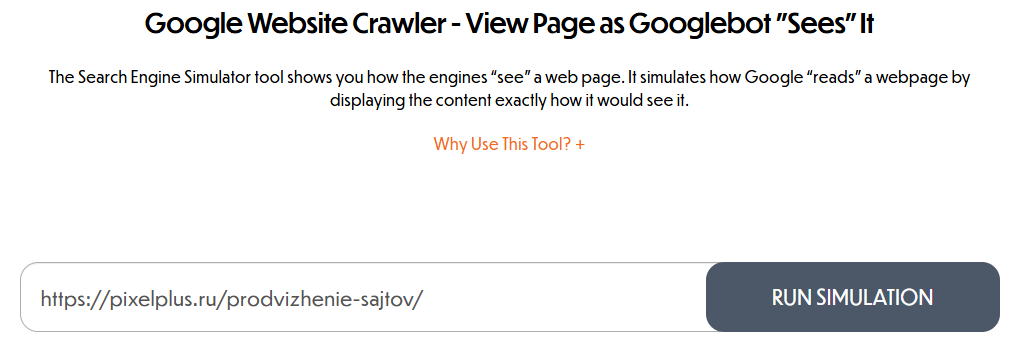

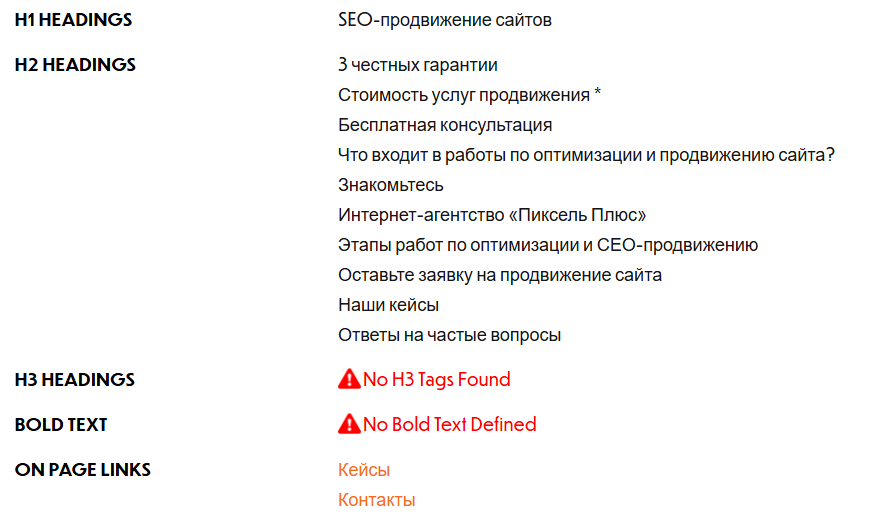

- Этот инструмент показывает как текст, так и ссылки, доступные Googlebot.

- Инструмент To The Web Google Website Crawler очень нагляден, поэтому, если вы объясняете кому-то проблему, этот инструмент позволяет легко увидеть, что доступно для Googlebot, а что нет.

- Этот инструмент выходит за рамки доступности для Googlebot и показывает частоту ключевых слов, заголовки, теги title, метаописания.

- Инструмент не позволяет проверять URL-адреса в большом масштабе — за раз можно вводить только один URL-адрес.

- Инструмент показывает только то, как видит вашу страницу робот Googlebot, а не какой-либо другой поисковый робот.

- Отсутствует визуализация страницы в формате скриншота.

- Вы можете выбирать нужный User-Agent.

- Инструмент покажет вам, к каким URL-адресам не удалось получить доступ и какие заблокированы для сканирования:

- Показан снимок экрана обработанной страницы, аналогичный Screaming Frog и Google Search Console.

- URL-адреса необходимо тестировать индивидуально.

- Данные о странице представлены из первоисточника, а не от сторонних сервисов.

- Инструмент бесплатный

- Одновременно можно тестировать только один URL-адрес.

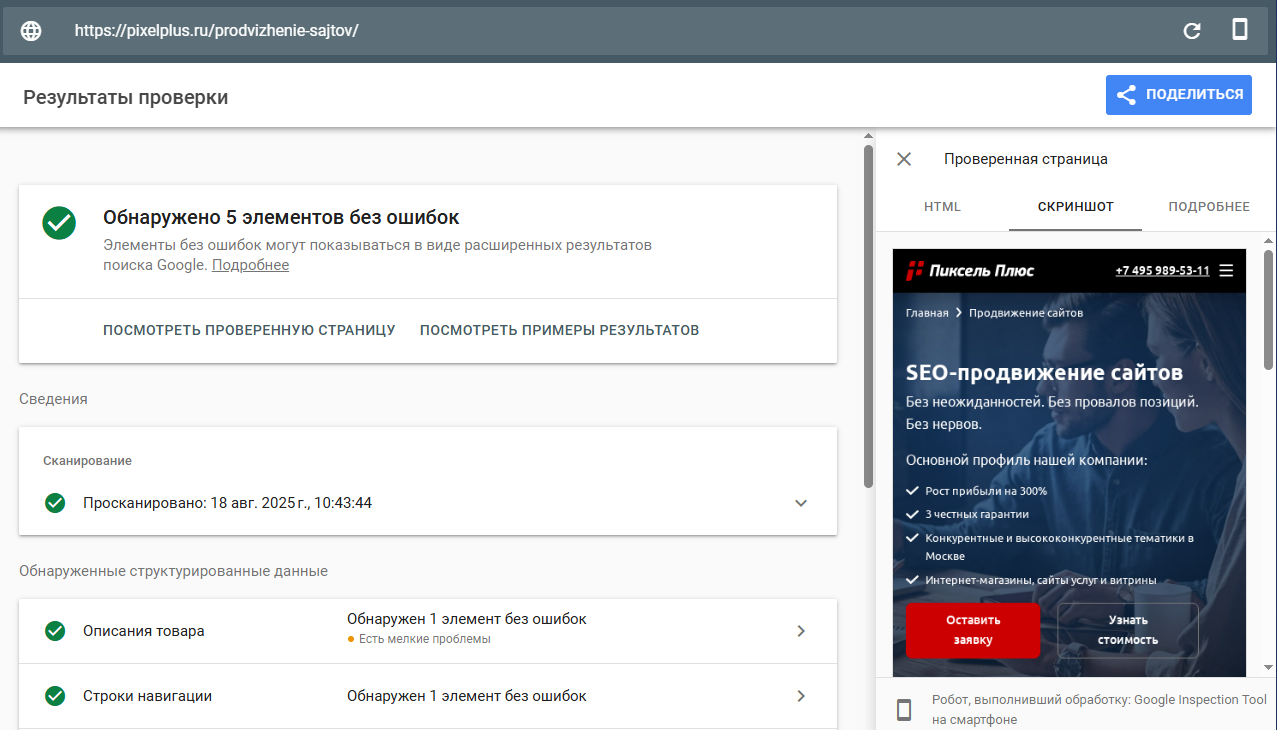

Если на скриншоте отсутствуют элементы вашей страницы, это может быть связано с блокировкой ресурсов для Googlebot. Вы можете узнать, какие ресурсы были заблокированы, нажав на вкладку «ПОДРОБНЕЕ» рядом с пунктом «СКРИНШОТ».

Преимущества:

Недостатки:

2. Screaming Frog SEO Spider

Программа Screaming Frog решает множество различных задач, и она является неотъемлемым инструментов любого SEO-специалиста.

Если вы не пользовались программой, то, по сути, от вас требуется просто ввести URL-адрес сайта и он просканирует ссылки по этому URL-адресу, чтобы найти связанные страницы и внешние ресурсы.

Screaming Frog позволяет обнаружить проблемы SEO, которые могут влиять на индексацию и ранжирование сайта, экспортировать URL-адреса, найти неработающие ссылки, дубли тегов и т. д.

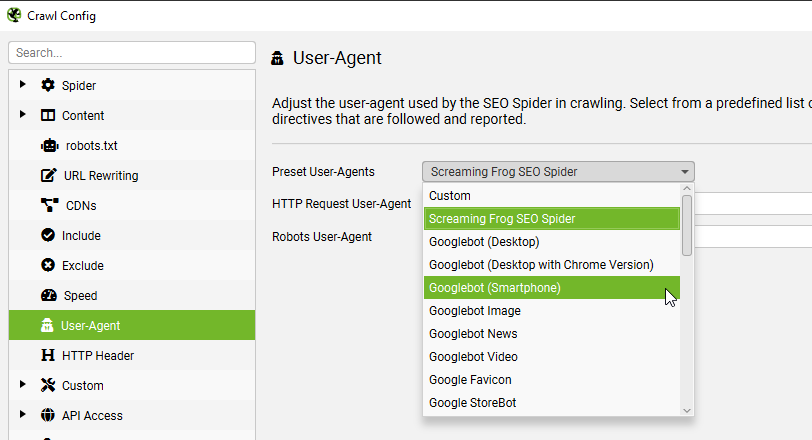

По умолчанию инструмент использует User-agent: Screaming Frog SEO Spider, но его можно изменить на агенты Googlebot, Bingbot, Yahoo-Slurp, DuckDuckBot и других.

Если вы хотите проверить, есть ли у вас проблемы с доступом Googlebot к контенту страниц, вы можете изменить User-agent, перейдя в раздел «Configuration» > «User-Agent» > и выбрать нужный в раскрывающемся списке.

Поскольку Google использует индексацию, ориентированную на мобильные устройства, рекомендуем начать с Googlebot Smartphone.

Далее вам просто нужно ввести URL-адрес или домен сайта, с которого вы хотите начать, и позволить Screaming Frog просканировать его до 100%.

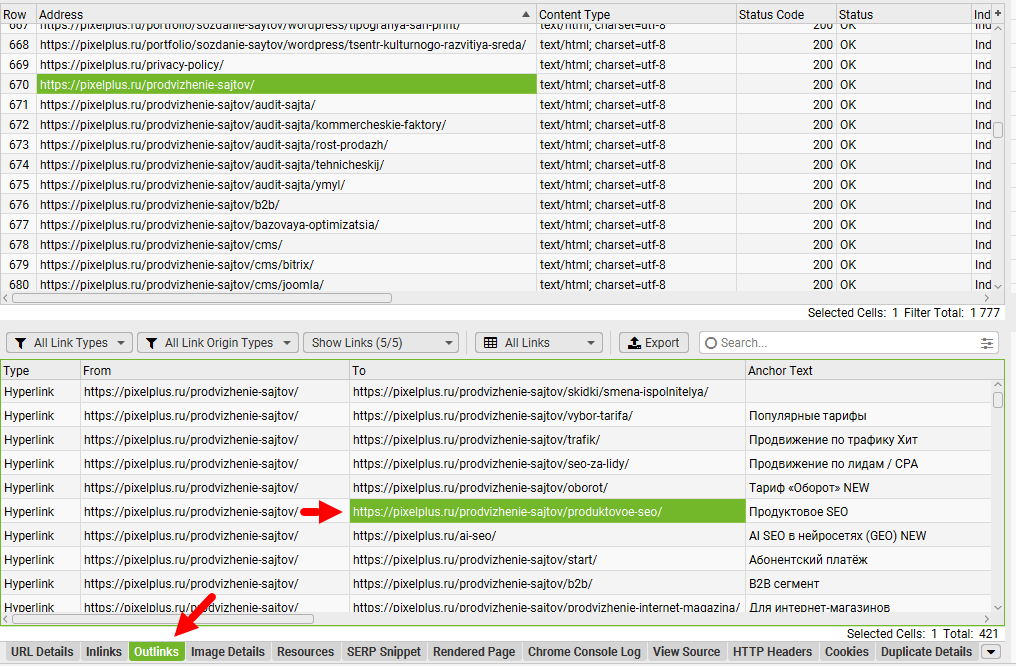

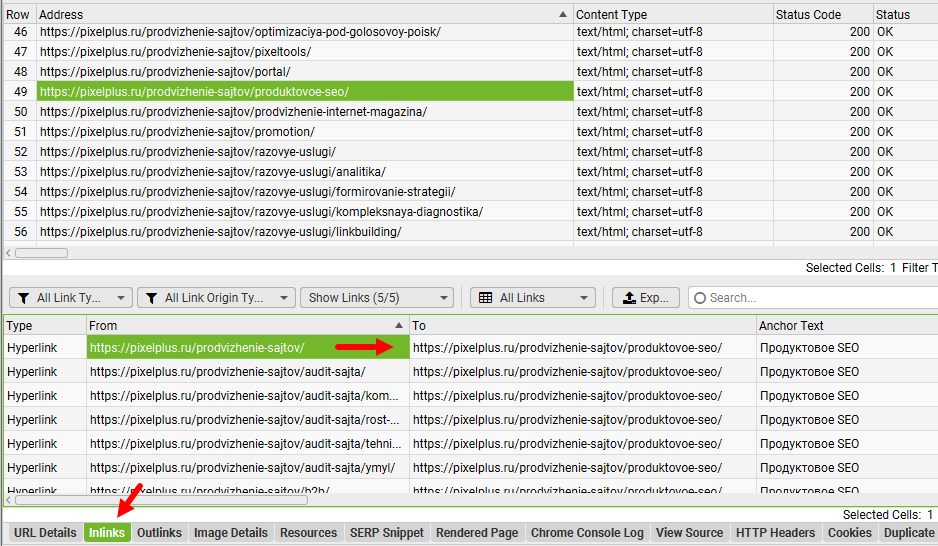

Если, например, вы считаете, что робот Googlebot не может получить доступ к ссылкам на отдельные URL раздела, сначала найдите основную страницу в результатах сканирования Screaming Frog и выберите ее.

Затем откройте вкладку «Outlinks» в нижней части инструмента, чтобы увидеть, какие ссылки Screaming Frog нашёл на этой странице. Если он не получает URL-адреса отдельных записей, это может быть признаком того, что робот Googlebot не может получить доступ к ссылкам на документы с основной страницы.

Вы также можете немного изменить процесс, выбрав URL-адрес отдельной страницы, а затем открыть вкладку «Inlinks», чтобы увидеть страницы, на которых программа нашла ссылку на эту запись. Если Screaming Frog не нашел публикацию как входящую ссылку из блога, это может быть признаком того, что Googlebot не может получить доступ к ссылкам на отдельные записи в вашем блоге.

Преимущества:

Недостатки:

3. Googlebot Crawler Simulator на сайте To The Web

Инструмент Google Website Crawler прост в использовании — просто введите нужный URL-адрес в строку поиска, и инструмент выдаст все ссылки, доступные Googlebot.

Преимущества:

Недостатки:

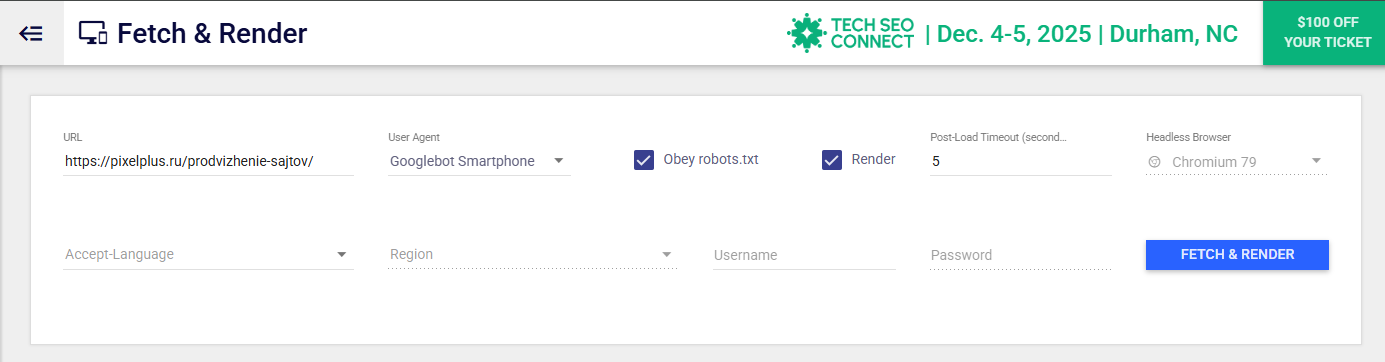

4. SEO-инструмент Dentsu Fetch & Render

Как и Googlebot Crawler Simulator, инструмент Fetch & Render такой же простой в использовании — необходимо ввести URL-адрес, выбрать User-Agent, настроить параметры, а затем запустить тест.

Преимущества:

Недостатки:

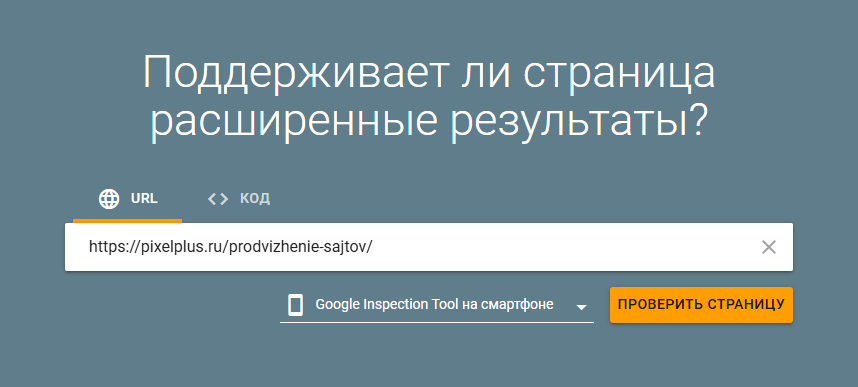

5. Проверка расширенных результатов Google

Сервис проверки расширенных результатов идентичен пункту №1 и его также можно использовать для постраничного анализа сайта. Для этого достаточно ввести необходимый URL-адрес страницы.

В результате проверки вы получите информацию о микроразметке страницы, а также сможете увидеть скриншот:

Преимущества:

Недостатки:

Как исправить проблемы доступности Googlebot на вашем сайте

Если вы попробовали все методы и выяснили, что контент страницы недоступен для поисковых роботов, самое время разобраться, в чём дело.

Выделим две наиболее распространенные проблемы:

1. Заблокирован доступ в robots.txt

Это может показаться очевидным, но стоит перепроверить. Если вы создали файл robots.txt, проверьте его, чтобы убедиться, что вы случайно не блокируете сканирование страниц.

Кроме того, отдельные страницы потенциально могут быть закрыты от индексации — либо с помощью вручную добавленного мета-тега <meta name="robots">, либо за счет настроек в CMS (плагин Yoast в WordPress, настройки индексации в Tilda и т.д.).

Наконец, если ваш сайт защищен брандмауэром или системой безопасности, например Cloudflare, убедитесь, что роботам поисковиков разрешен доступ на ваш сайт для сканирования и индексации страниц.

2. Рендеринг на стороне клиента

В связи с популярностью систем управления контентом и платформ электронной коммерции, клиентская обработка стала серьезной проблемой для SEO. Это, в основном, проблема разработки программного обеспечения, когда программисты используют ту или иную технологию, не понимая, как она влияет на работу поисковых роботов и индексацию сайта.

Когда посетитель или поисковый робот заходит на ваш сайт, его браузер отправляет запрос на ваш сервер. Затем сервер визуализирует полный HTML-код вашей страницы, включая динамический контент, и возвращает его посетителю в виде отображения в его браузере. Это называется рендерингом на стороне сервера (SSR: Server Side Rendering).

При клиентском рендеринге (CSR: Client Side Rendering) когда посетитель или поисковый робот отправляет запрос к вашему серверу, сервер отвечает практически пустым HTML-файлом, содержащим ссылки на файлы JavaScript с данными и инструкциями о том, как браузер посетителя должен отображать страницу. Это часто включает загрузку и отображение частей страницы, с которыми пользователь уже взаимодействовал, а не при первоначальной загрузке.

Проблема CSR заключается в том, что, хотя большинство из поисковиков могут выполнять JavaScript, они спроектированы для очень быстрого перехода между страницами. Когда робот получает от сервера практически пустой ответ, он практически не находит контента для индексации и может продолжить работу до того, как связанные данные JavaScript будут загружены.

Кроме того, если некоторые элементы страницы, например, главное навигационное меню, заполняются только по клику или наведению курсора, содержимое внутри меню не будет индексироваться или сканироваться, поскольку оно будет невидимо для робота.

Несмотря на то, что существуют решения для разработки клиентских сайтов, корректно отображаемых с точки зрения SEO, разработчики зачастую не учитывают это и не всегда понимают критичность влияния своих решений на сканирование страниц сайта.

Некоторые современные фреймворки, такие как Next.js или Nuxt, предлагают различные режимы рендеринга, и их необходимо тщательно продумать. Разработчики также должны быть более внимательны к SEO-требованиям при работе с сайтом.

Если вы подозреваете, что на вашем сайте есть проблемы с полнотой индексации контента, но не знаете, как их выявить или устранить, можете обратиться к нашим специалистам по SEO и разработке. Мы поможем вам разобраться!

на рассылку

Комментариев пока что нет

Наши достижения

Входим в число лучших компаний России в сферах интернет-рекламы и разработки сайтов по результатам самых авторитетных рейтингов

-

GEO-продвижение: гайд повышени...

GEO-продвижение: гайд повышени...

GEO (Generative Engine Optimization) — это направление онлайн-маркетинга, направленное на рост видимости и числа упоминаний бренда и его...10 февраля -

AI SEO в 2026 году: ключевая р...

AI SEO в 2026 году: ключевая р...

В 2026 году искусственный интеллект серьёзно изменит подход к оптимизации сайтов.22 января -

ТОП-5 ИИ-сервисов для замены ф...

ТОП-5 ИИ-сервисов для замены ф...

Для тех, кто уже устал сам редактировать изображения, появился ИИ замены фона на фото.16 января -

Агрегатор нейросетей: ТОП-15 A...

Агрегатор нейросетей: ТОП-15 A...

Когда все нужные нейронки собраны в одном месте, работать становится гораздо проще и удобнее.16 января -

Как стать № 1 в Google за счет...

Как стать № 1 в Google за счет...

Одна из проблем, которая существенно тормозит продвижение сайта в результатах выдачи Яндекс и Google, неверное понимание зон ответственности сторон &m...15 декабря -

Продвижение в нейросетях 2025-...

Продвижение в нейросетях 2025-...

Период первоначального любопытства к искусственному интеллекту завершился.23 октября -

Robots.txt vs Meta-тег robots:...

Robots.txt vs Meta-тег robots:...

Каждый месяц сотни сайтов теряют позиции в поиске из-за неправильных настроек для роботов поисковых систем.23 октября -

KPI в SEO: как выбрать показат...

KPI в SEO: как выбрать показат...

Поисковое продвижение сайта часто воспринимают как средство для улучшения позиций в поисковых системах.29 сентября -

Как добавить свой сайт в Bing ...

Как добавить свой сайт в Bing ...

Bing является основным поставщиком данных для многих генеративных AI-систем, включая ChatGPT.22 сентября -

Реклама в мобильных приложениях

Реклама в мобильных приложениях

По информации маркетингового агентства Crucial, пользователи смартфонов проводят в приложениях около 88% мобильного времени.11 апреля -

Как выгрузить больше 1000 запр...

Как выгрузить больше 1000 запр...

В панели Google Search Console по умолчанию можно выгрузить не более 1000 строк данных, что зачастую крайне мало для полноценного анализа.11 апреля -

Как заработать на мобильном пр...

Как заработать на мобильном пр...

Вовлеченность и интерес пользователей можно успешно монетизировать. Рассказываем, как и сколько можно заработать на приложении в Google Play.11 апреля

-

Корпоративное мобильное прилож...

Корпоративное мобильное прилож...

Кому надо и когда пора делать корпоративное мобильное приложение1 мая -

4 фактора устойчивой популярно...

4 фактора устойчивой популярно...

Если вы хотите сделать приложение, начинайте с Android. Для этого есть 4 веские причины…1 мая -

IoT разработка: как создать ре...

IoT разработка: как создать ре...

IoT разработка — это создание систем, в которых физические устройства собирают данные и обмениваются ими через интернет. В этой статье разобрано всё: ...10 апреля -

Что такое API и как это работа...

Что такое API и как это работа...

В этой статье объясняется, что такое API, как устроен принцип его работы и где он применяется. Материал будет полезен разработчикам, предпринимател...

10 апреля -

UX-исследования: методы, виды ...

UX-исследования: методы, виды ...

Создание цифровых продуктов сегодня — это сложный процесс, где каждая ошибка может стоить миллионы. Чтобы не действовать вслепую и не тратить бю...16 марта -

Когда пора заказать разработку...

Когда пора заказать разработку...

Когда разработка собственного приложения становится спасением для бизнеса?12 марта -

Купить готовое приложение или ...

Купить готовое приложение или ...

Сколько можно сэкономить, если купить готовое приложение для бизнеса11 марта -

-

-

Цена мобильного приложения для...

Цена мобильного приложения для...

Сколько стоит мобильное приложение в 2026 году: порядок цен на разные виды мобильных сервисов10 марта -

Meta-тег robots и canonical: к...

Meta-тег robots и canonical: к...

Meta-тег robots и canonical часто настраивают одновременно, но сочетают неправильно.25 февраля -

Core Web Vitals: как измерять ...

Core Web Vitals: как измерять ...

Core Web Vitals — это фундаментальный набор метрик, разработанный Google для оценки качества пользовательского опыта при взаимодействии с веб-ст...12 февраля

Нужна помощь с сайтом? Заполните форму, и наши менеджеры проконсультируют вас уже сегодня!

а также спецпредложения только для подписчиков!